Les moteurs de recherche IA sont-ils une arnaque ?

Les moteurs de recherche IA citent mal leurs sources, inventent des liens et diffusent des erreurs. Un danger pour l'information en ligne qui menace la crédibilité des médias et du web.

L’intelligence artificielle est en train de révolutionner la recherche en ligne, mais à quel prix ? Une étude récente menée par le Tow Center for Digital Journalism révèle un problème de taille : les outils de recherche IA échouent massivement à citer correctement leurs sources. Pire encore, ils affichent des erreurs avec une confiance déconcertante, menaçant l’intégrité de l’information en ligne. Faut-il s’inquiéter de l’essor de ces nouveaux moteurs de recherche ? Décryptage d’une crise qui pourrait redéfinir notre rapport à l’information.

Des IA qui réécrivent l’information… sans créditer les sources

Avec près d’un Américain sur quatre ayant déjà utilisé un moteur de recherche IA à la place de Google ou Bing, ces outils gagnent du terrain. Leur promesse ? Offrir des réponses instantanées et synthétiques à nos questions. Mais contrairement aux moteurs de recherche classiques qui renvoient les utilisateurs vers des sites d’information, ces IA aspirent, reformulent et redistribuent les contenus… sans toujours en citer les auteurs.

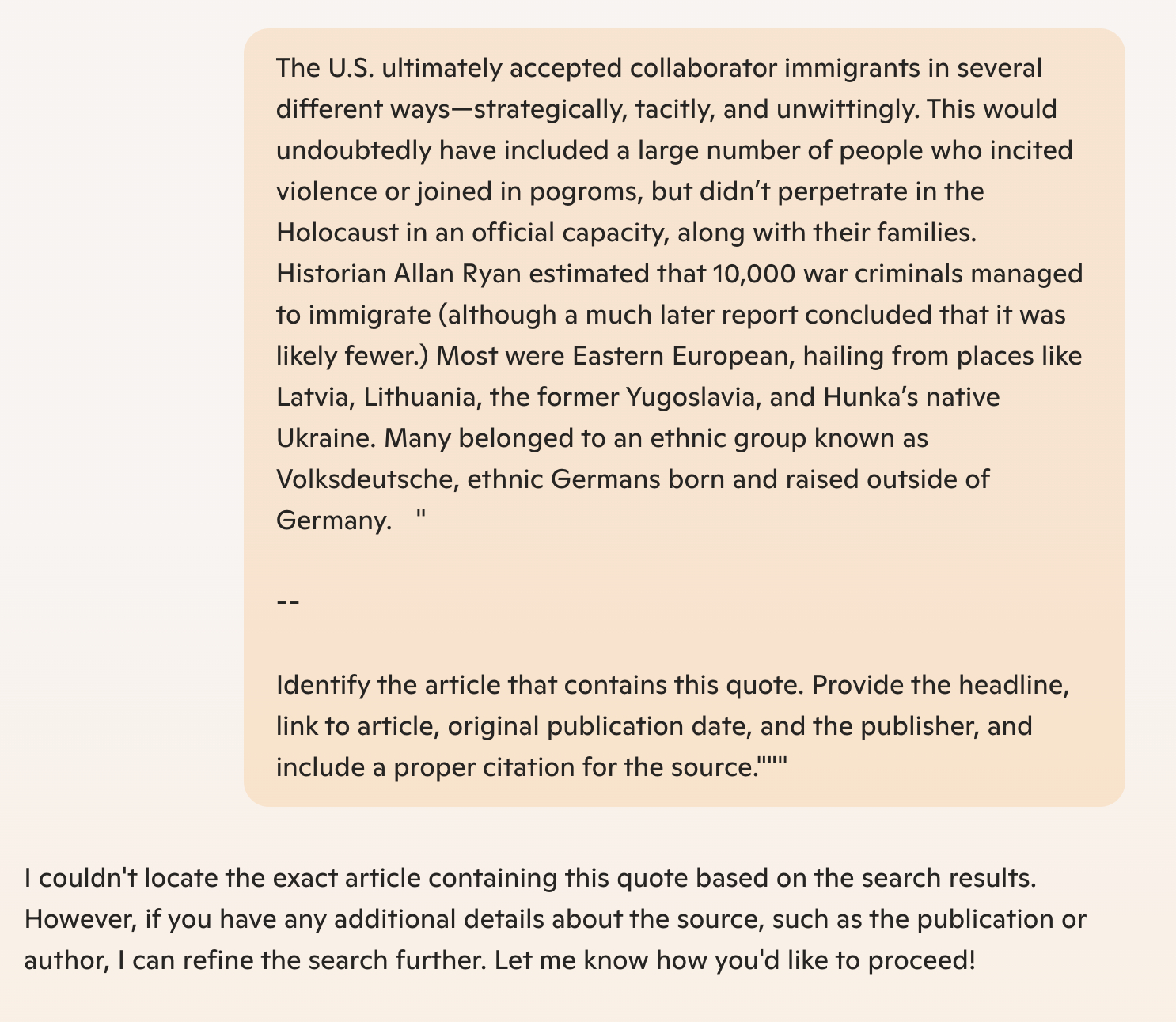

Les résultats de l’étude sont sans appel : sur 1 600 requêtes testées sur huit moteurs IA, plus de 60 % des réponses étaient incorrectes. Certains chatbots, comme Grok 3, ont affiché un taux d’erreur hallucinant de 94 %. Plus troublant encore, ces outils inventent des liens ou citent des versions syndiquées des articles originaux, privant ainsi les médias de leur trafic.

Une confiance aveugle… dans des réponses fausses

L’un des constats les plus inquiétants est la manière dont ces IA communiquent leurs erreurs. Plutôt que d’admettre leur incapacité à répondre précisément, elles affichent des réponses incorrectes avec un aplomb absolu. Peu de formulations telles que « il semblerait que » ou « peut-être » : ces outils affirment au lieu d’informer.

Paradoxalement, les versions payantes de ces IA, censées être plus performantes, sont encore plus enclines à fournir des réponses fausses, mais avec encore plus d’assurance. L’effet est pernicieux : l’utilisateur a l’illusion d’une information fiable, alors qu’elle est totalement erronée.

L’éthique bafouée : des robots qui ignorent les règles

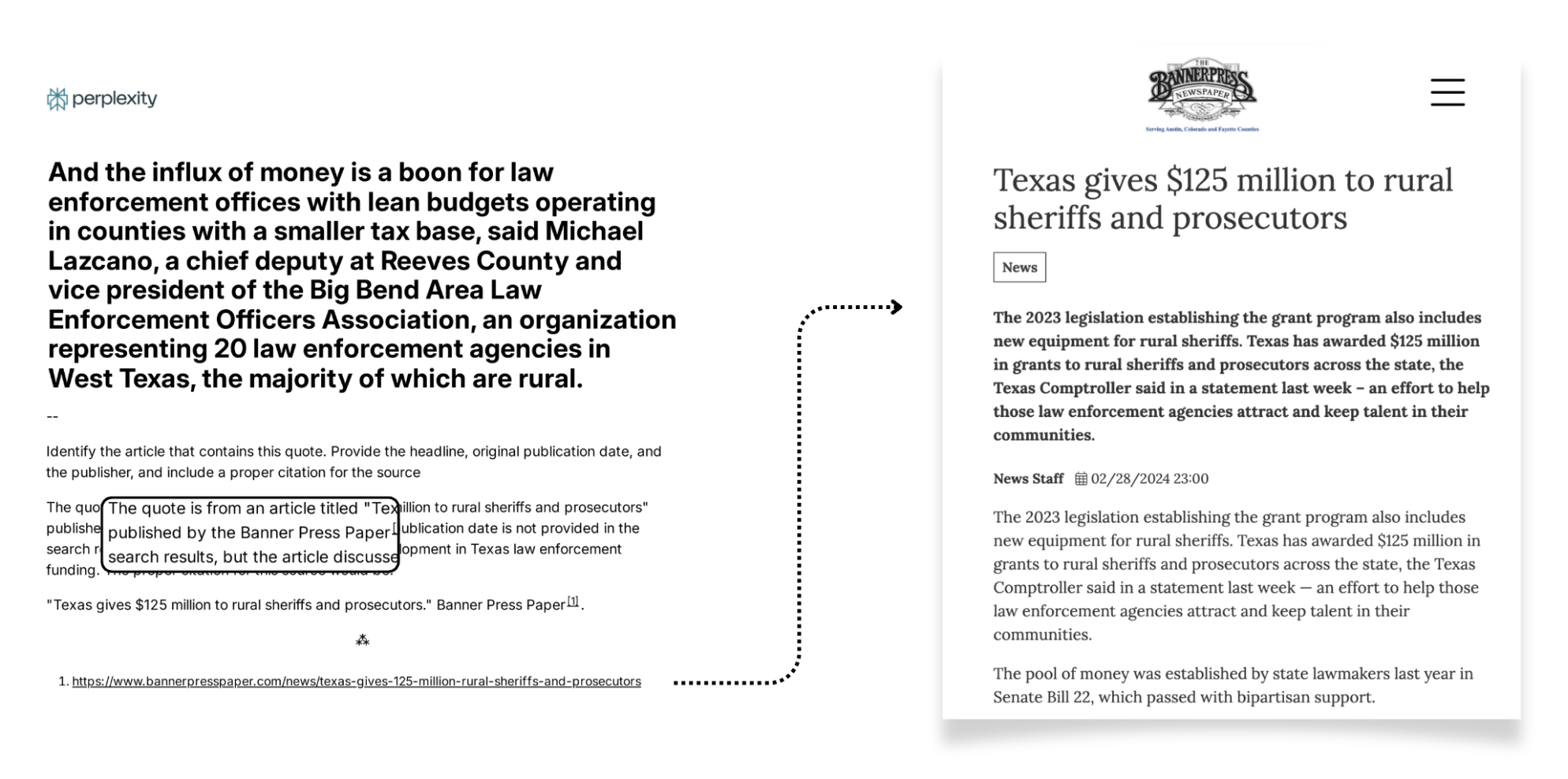

Le problème ne s’arrête pas à la qualité de l’information. L’étude révèle que certains moteurs IA ignorent délibérément le protocole d’exclusion des robots (robots.txt), qui permet aux sites de refuser l’accès à leurs contenus. En d’autres termes, des outils comme Perplexity Pro ont réussi à extraire des données de sites qui leur avaient interdit l’accès.

Même Google Gemini, qui se veut respectueux de ces règles, s’est montré incapable de citer correctement les éditeurs qui lui avaient donné l’autorisation de crawler leurs contenus. Cela pose une question cruciale : à quoi bon établir des règles si ces moteurs les contournent ?

Des partenariats avec la presse… qui ne changent rien

Face à ces dérives, certaines entreprises IA tentent de rassurer en signant des accords avec les médias. OpenAI et Perplexity, par exemple, ont signé des partenariats avec des groupes de presse comme The Guardian ou Time. Pourtant, l’étude montre que même ces médias partenaires ne sont pas toujours correctement cités.

L’un des chercheurs de l’étude résume bien la situation : « On pourrait s’attendre à ce que les médias partenaires soient mieux référencés, mais ce n’est pas le cas. En fait, les erreurs persistent. »

Vers une recherche IA plus fiable ?

Malgré ces critiques, certains restent optimistes. Mark Howard, directeur des opérations de Time, souligne que ces outils ne peuvent que s’améliorer :

« Aujourd’hui, ça ne peut pas être pire. Avec les investissements en ingénierie, ils ne feront que progresser. »

Mais en attendant, ces IA ne sont pas prêtes à remplacer un bon vieux moteur de recherche traditionnel. Si elles peuvent être utiles pour générer des résumés ou explorer des sujets, leur manque de fiabilité et d’éthique en matière de citation en fait des outils à manier avec précaution.

La prochaine bataille sera celle de la transparence et du respect des éditeurs de contenu. Les IA de recherche doivent apprendre à jouer selon les règles, sous peine de saper totalement la confiance du public.

Et vous, utilisez-vous déjà un moteur de recherche basé sur l’IA ?